目录

前言背景

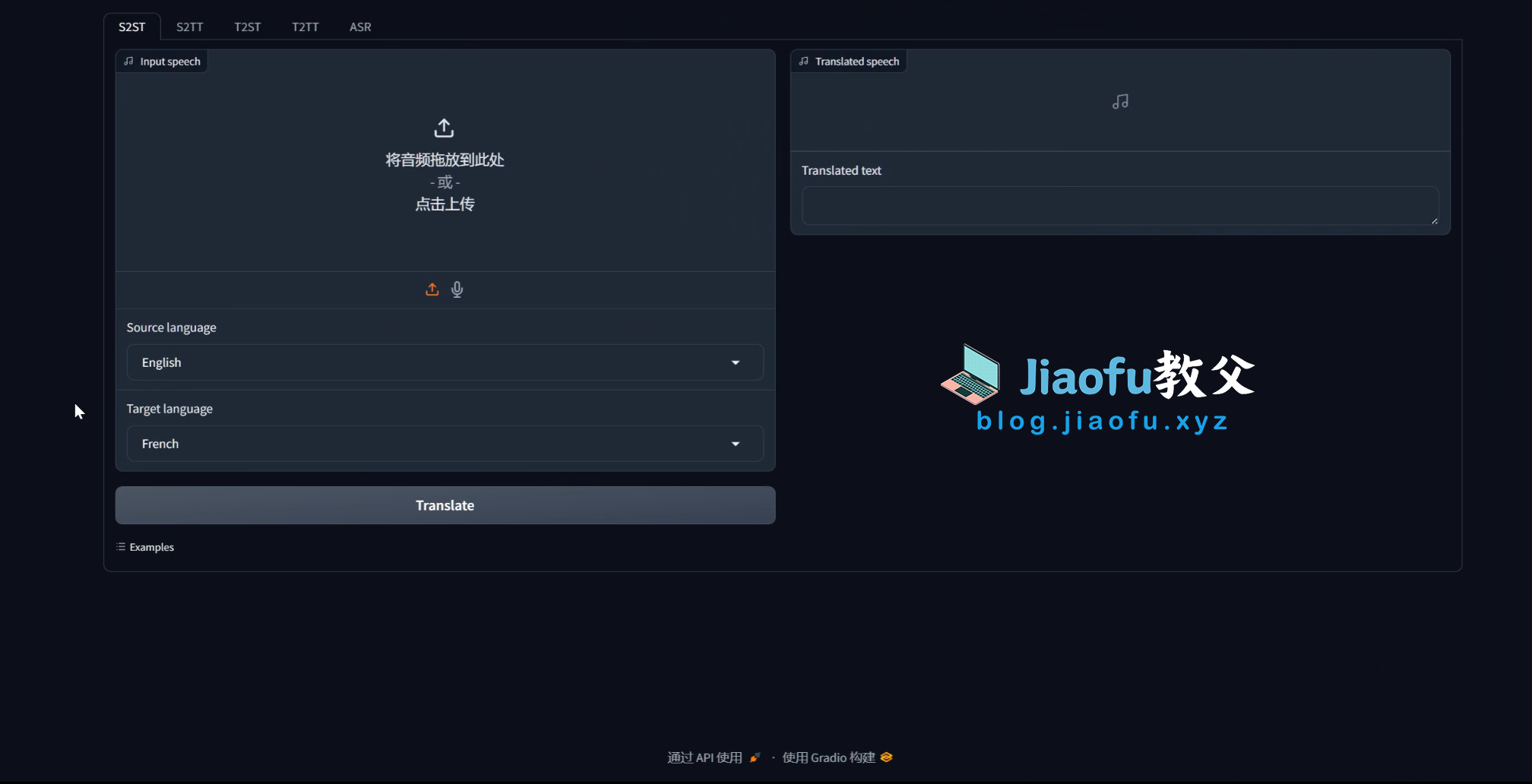

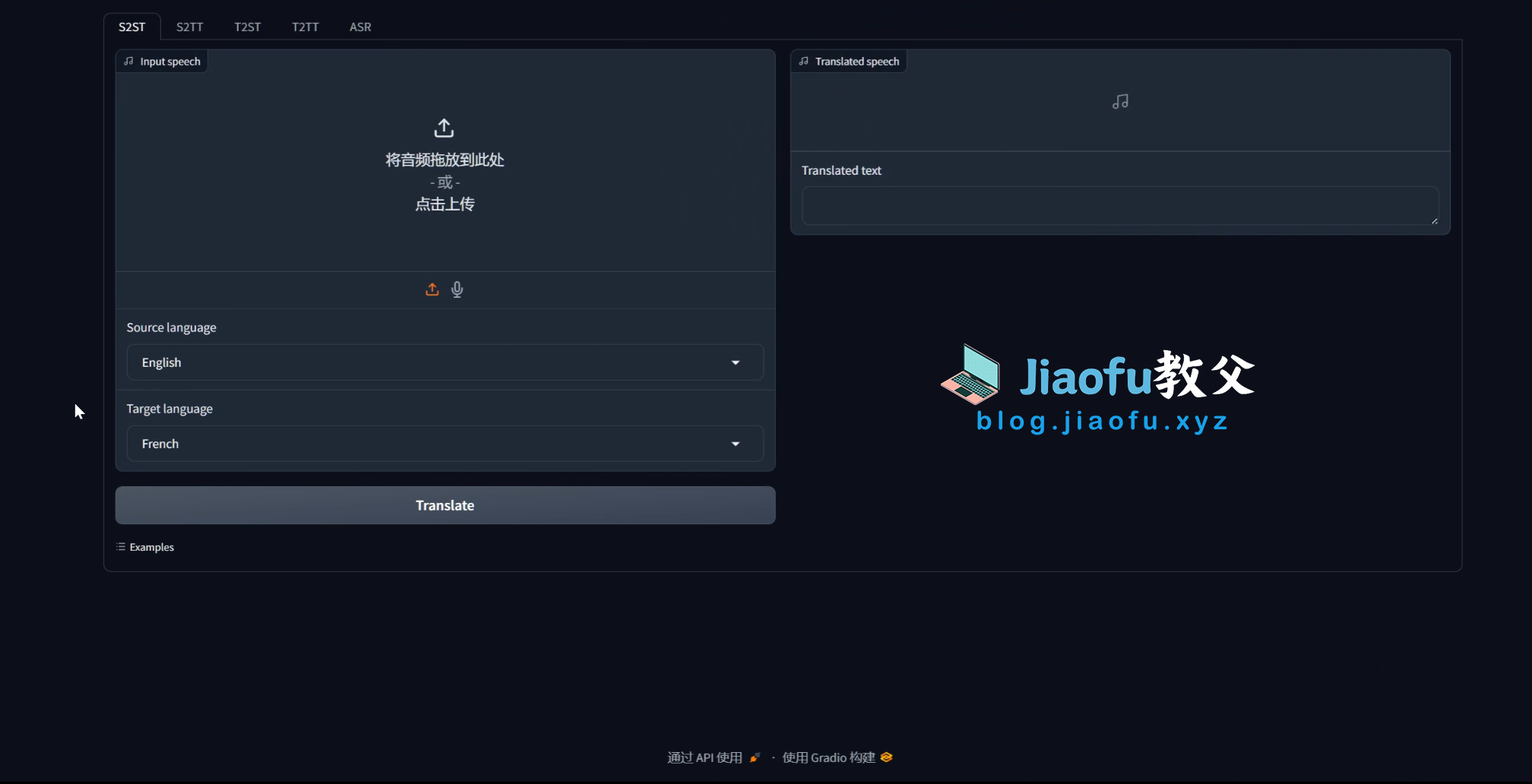

本教程将指导您部署语音翻译模型,该模型由Meta(Facebook的母公司,扎克伯格的公司)开源,是一款多模态、多任务的语音翻译利器。此模型对硬件要求极低,却能提供出色的翻译效果,同时,它也展示了Meta在多模态、多任务语音翻译领域的最新研究成果。Meta开源此项目,不仅有助于技术的广泛传播和应用,也为全球的开发者和研究人员提供了一个强大的工具和平台。Meta的研究团队致力于推动跨语言和跨模态的无缝通信,通过开源项目分享他们的研究成果,旨在促进全球范围内的技术进步与合作。

自ChatGPT问世以来,Meta在开源领域的动作频频,其力度堪比当年Google Android与Apple iOS之争。我个人最敬佩的三家公司是微软、Google和Meta。微软的开源项目不计其数,甚至收购了GitHub以支持其运营;Google更是不用多说,Android便是其杰作。而Meta的开源项目主要集中在AI领域,包括大语言模型LLaMA、语音翻译以及涂鸦绘画等。正是这些科技巨头的贡献,才铸就了我们今天所见的互联网高楼大厦。

或许有人会说,这些巨头有钱,开源是理所当然的。然而,这是一种典型的“坐享其成”思维。放眼国内公司,以及像Apple这样并不缺钱的公司,它们甚至恨不得对每个字符都收费。闲话少叙,现在我们开始正文。

前期准备

- 一台有GPU的服务器或者一台Windows带有wsl服务的个人电脑。

- 最低GPU配置:Nvidia显卡,显存6G+。推荐GPU配置:Nvidia显卡,显存8G+。

- 系统:Ubuntu 22.04 LTS/Ubuntu 24.04 LTS都可以(我没测试Ubuntu 20.04 LTS是否可行,理论上是可以的)。

云服务器部署(推荐)

这里为什么推荐用云服务。

首先因为本项目目前不支持Windows部署,而一般情况下个人PC都是Windows系统,就算家里有废旧电脑装了Linux,但是显卡配置这关是过不了的,AI项目显卡是必须的。

另一方面,使用Windows子系统服务wsl来装系统的话,其实就是在你电脑上建一台虚拟机。wsl与其他虚拟机软件区别在于其是Windows系统内置,契合度高,可以调用GPU资源(这是最主要的,因为家用显卡不支持虚拟化,市面上虚拟机基本是没法使用GPU的)。但是不要忽略其缺点。它的数据都是以特定格式存储到C盘,不同于其他虚拟机软件,可以更改默认位置。就算你通过魔改来实现改存储位置,但是大部分数据还是在C盘,这对于普通用户来说,非常不友好,容易把电脑搞得乱七八糟的,要不了多久就只能重装系统了。如果你的电脑专门用来做开发的,那wsl无疑是好用且最具经济的方式了,那就不必买云服务了

这里推荐大家使用Vultr。费用非常低,并且随开随用,按小时计费,还有一个优点就是带宽非常大。

这里为了避免重复写教程,看我之前的这篇文章中如何部署服务器的教程(教程中有几个不同点需要注意,选择的服务器类型要选择GPU服务器。另外对于配置,建议选A16 8G,这个目前性价比最高,其他要不贵了,要不配置低了,都不是最优选)。

云服务需要SSH远程连接。如果你自己有远程软件,就用自己的。如果没有,我这里提供了免费免安装版本Xshell高级版(Xshell不用过多介绍了,业界收费远程连接软件No.1)。下载解压出来即可使用。

这里为了避免重复写教程,SSH远程如何使用看我之前的这篇文章。